Giải pháp tăng hiệu suất của máy chủ

Giải pháp tăng hiệu suất của máy chủ: Tối ưu đúng điểm nghẽn để server chạy nhanh và ổn định hơn

Trong thực tế vận hành, nhiều doanh nghiệp nhận thấy máy chủ chạy chậm nhưng lại không xác định được nguyên nhân chính xác nằm ở đâu. Có nơi nâng CPU nhưng hệ thống vẫn chậm. Có nơi tăng RAM nhưng tốc độ website không cải thiện nhiều. Cũng có trường hợp ứng dụng phản hồi kém không phải vì thiếu tài nguyên, mà vì bottleneck nằm ở ổ cứng, cấu hình web server, network stack hoặc cơ chế cache chưa hợp lý.

Đó là lý do việc tăng hiệu suất máy chủ cần được nhìn như một bài toán tổng thể, không phải chỉ là nâng cấu hình. Theo Red Hat, tối ưu hiệu suất hiệu quả bắt đầu từ việc xác định bottleneck trong môi trường vận hành bình thường; còn Microsoft cho biết việc tuning chỉ thực sự có ý nghĩa khi bám theo workload cụ thể và mục tiêu rõ ràng như throughput, latency hay energy efficiency.

Hiệu suất máy chủ bị ảnh hưởng bởi những yếu tố nào?

Hiệu suất server thường chịu tác động đồng thời từ nhiều lớp:

- CPU và số lượng core xử lý

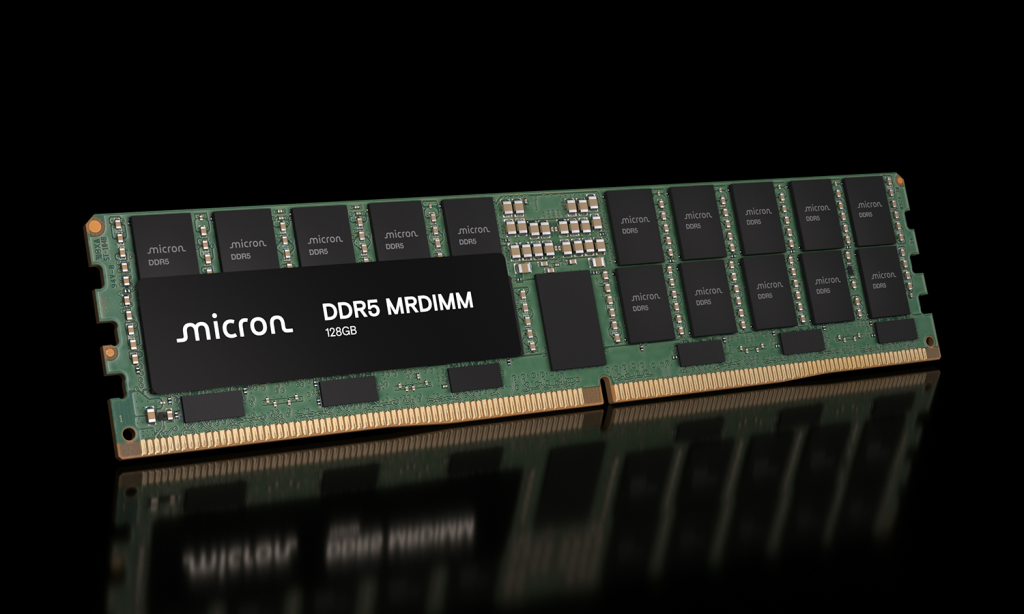

- RAM và khả năng giữ working set trong bộ nhớ

- tốc độ đọc ghi của ổ cứng

- băng thông mạng và độ trễ kết nối

- cấu hình hệ điều hành

- web server, database và ứng dụng

- cơ chế cache

- cân bằng tải và phân phối truy cập

- giám sát và phát hiện sớm sự cố

AWS nhấn mạnh rằng monitoring là một phần quan trọng để duy trì reliability, availability và performance; còn Red Hat xem performance tuning là quá trình tối ưu các subsystem khác nhau của hệ thống, không chỉ một thành phần đơn lẻ.

1. Xác định đúng bottleneck trước khi nâng cấp

Đây là bước quan trọng nhất nhưng cũng thường bị bỏ qua.

Khi server chậm, doanh nghiệp hay phản xạ bằng cách mua thêm CPU hoặc RAM. Tuy nhiên, nếu bottleneck thực sự nằm ở I/O ổ cứng hoặc network path, việc nâng CPU sẽ không giải quyết được vấn đề. Một hệ thống muốn tối ưu hiệu suất phải được theo dõi theo các chỉ số như CPU usage, memory pressure, disk latency, iowait, network throughput, session đồng thời và thời gian phản hồi ứng dụng. AWS khuyến nghị thu thập dữ liệu giám sát từ toàn bộ các thành phần trong hệ thống để dễ debug lỗi đa điểm; còn Microsoft cũng xây dựng riêng các hướng dẫn tuning cho từng nhóm workload và phần cứng.

Nói ngắn gọn: đo trước, tối ưu sau.

2. Tăng RAM đúng cách để giảm truy xuất đĩa

Một trong những nguyên nhân phổ biến khiến máy chủ phản hồi chậm là dữ liệu phải đọc từ đĩa quá thường xuyên thay vì nằm sẵn trong RAM. AWS nêu rõ với cơ sở dữ liệu, nên cấp đủ RAM để working set nằm gần như hoàn toàn trong bộ nhớ, vì dữ liệu và index được dùng thường xuyên nếu phải đọc từ storage sẽ làm hiệu năng suy giảm đáng kể.

Không chỉ database, web server, reverse proxy, cache layer và application server cũng hưởng lợi rõ rệt từ RAM đủ lớn. Khi có nhiều RAM hơn, hệ thống có thể:

- giữ cache hiệu quả hơn

- giảm swap

- giảm độ trễ khi xử lý request

- tăng số lượng kết nối hoặc session đồng thời

Tuy nhiên, tăng RAM chỉ hiệu quả khi đây là điểm nghẽn thật sự. Nếu storage quá chậm hoặc ứng dụng viết chưa tối ưu, việc thêm RAM chỉ giải quyết được một phần.

3. Ưu tiên SSD hoặc NVMe cho máy chủ

Với kinh nghiệm triển khai hạ tầng thực tế, đây là một trong những giải pháp mang lại khác biệt rõ nhất.

Nếu server vẫn đang phụ thuộc vào HDD hoặc storage có độ trễ cao, hiệu năng tổng thể thường bị kéo xuống đáng kể, nhất là với website động, database, hệ thống ERP, CRM, ảo hóa hoặc file server nhiều truy cập đồng thời. Microsoft khuyến nghị hạ tầng hiện đại nên dùng PCIe cho storage và network interface; AWS cũng lưu ý theo dõi chỉ số iowait để phát hiện bottleneck do đĩa chậm.

So với HDD, SSD và đặc biệt là NVMe giúp:

- tăng tốc đọc ghi ngẫu nhiên

- giảm latency cho database

- rút ngắn thời gian khởi động dịch vụ

- cải thiện khả năng phục vụ nhiều request cùng lúc

- tăng tốc cache, log, temp file và transaction processing

Nếu ngân sách cho phép, SSD/NVMe gần như là lựa chọn nên ưu tiên đầu tiên khi muốn tăng tốc server.

4. Tối ưu CPU nhưng phải đúng workload

CPU không phải lúc nào cũng là “thủ phạm chính”, nhưng với workload tính toán nhiều, mã hóa, nén, xử lý ứng dụng backend hoặc ảo hóa, đây vẫn là thành phần cực kỳ quan trọng. Microsoft cho biết tuning phải bám vào mục tiêu như latency thấp nhất hoặc throughput cao nhất; đồng thời power plan và các thiết lập phần cứng cũng có thể ảnh hưởng đến hiệu năng. Windows Server cung cấp các power plan như Balanced, High Performance và Power Saver, trong đó lựa chọn kế hoạch điện năng phù hợp có thể tác động đến hành vi xử lý của hệ thống.

Ngoài việc tăng core hoặc nâng CPU, doanh nghiệp nên kiểm tra thêm:

- CPU có bị contention không

- ứng dụng có tận dụng đa luồng tốt không

- có tiến trình nào chiếm CPU bất thường không

- có đang nén, mã hóa hoặc xử lý log quá mức không

Tăng CPU chỉ thực sự đáng tiền khi CPU là điểm nghẽn được xác nhận bằng số liệu.

5. Tối ưu mạng và card mạng

Nhiều hệ thống chậm không phải do ứng dụng yếu mà do network stack hoặc card mạng chưa được khai thác đúng. Microsoft khuyến nghị với Windows Server 2022, primary storage và network interfaces nên dùng PCIe; với adapter Ethernet 10Gb trở lên, nên dùng khe PCIe x8 hoặc cao hơn để tránh giới hạn bus speed. Ngoài ra, Microsoft cũng nhấn mạnh việc cài driver storage và networking mới, ổn định và nhanh là một bước quan trọng trước khi cấu hình tuning sâu hơn.

Với hạ tầng doanh nghiệp, các giải pháp mạng giúp tăng hiệu suất thường gồm:

- nâng cấp cổng mạng từ 1GbE lên 10GbE hoặc cao hơn khi cần

- tối ưu driver NIC

- phân tách traffic nếu cần

- giảm dịch vụ không cần thiết

- kiểm tra MTU, queue, interrupt handling và kết nối uplink

Đây là nhóm tối ưu đặc biệt quan trọng với file server, virtualization host và hệ thống backup lớn.

6. Dùng cache để giảm tải cho server

Caching là giải pháp gần như luôn có giá trị nếu hệ thống phục vụ nhiều request lặp lại. Theo tài liệu chính thức của NGINX, content caching có thể cache cả nội dung tĩnh và động từ các web/app server phía sau để tăng tốc phân phối nội dung cho client và giảm tải cho server gốc.

Trong thực tế, cache có thể triển khai ở nhiều lớp:

- cache trình duyệt

- cache web server hoặc reverse proxy

- cache ứng dụng

- object cache

- query cache hoặc page cache

- CDN cache cho nội dung tĩnh

Nếu làm đúng, cache không chỉ giúp website nhanh hơn mà còn giảm CPU, RAM và I/O trên backend.

7. Dùng reverse proxy và load balancing để phân phối tải

Khi server bắt đầu chịu tải lớn, chỉ nâng cấu hình một máy chủ thường không còn là cách bền vững nhất. NGINX cho phép cân bằng tải HTTP, TCP và UDP, với nhiều thuật toán phân phối request; Google Cloud cũng mô tả load balancing là cơ chế phân phối traffic tới nhiều application instances để tối ưu hiệu năng cho người dùng cuối.

Load balancing giúp:

- tránh dồn toàn bộ truy cập vào một node

- mở rộng hệ thống theo chiều ngang

- tăng tính sẵn sàng

- hỗ trợ rolling update tốt hơn

- giảm nguy cơ một máy chủ bị quá tải

Nếu kết hợp với reverse proxy, buffering và keepalive connection, hiệu quả thường còn rõ hơn với website có lượng truy cập cao.

8. Bật nén và tối ưu web server

Với website, API hoặc portal nội bộ, web server là lớp tác động trực tiếp đến thời gian phản hồi. NGINX có tài liệu riêng cho compression/decompression và reverse proxy, cho thấy việc tối ưu cách request được chuyển tiếp, buffer phản hồi và nén dữ liệu là một phần quan trọng trong tối ưu web performance. Google Cloud cũng cho biết Application Load Balancer có thể cải thiện web performance nhờ xử lý kết nối ở edge, dùng các giao thức hiện đại như HTTP/2, QUIC và TLS 1.3, đồng thời giảm overhead nhờ persistent connections tới origin.

Các hướng tối ưu thường gặp gồm:

- bật gzip hoặc cơ chế nén phù hợp

- tinh chỉnh keepalive

- tối ưu worker process, worker connections

- bật caching cho static content

- giảm request không cần thiết

- tối ưu timeout và buffer

Đây là nhóm giải pháp mang lại hiệu quả cao với chi phí đầu tư thấp hơn so với thay phần cứng.

9. Loại bỏ dịch vụ không cần thiết

Microsoft khuyến nghị không bật những dịch vụ hoặc tính năng mà file server và client không cần dùng. Nguyên tắc này cũng đúng với hầu hết loại server khác: dịch vụ dư thừa sẽ tiêu tốn RAM, CPU, I/O, mở rộng bề mặt tấn công và làm khó việc giám sát.

Một server “gọn” thường chạy ổn định hơn một server “ôm đủ thứ”.

10. Thiết lập monitoring và cảnh báo chủ động

Không có giám sát thì không thể tối ưu bền vững. AWS nhấn mạnh monitoring là phần quan trọng để duy trì reliability, availability và performance của instance cũng như toàn bộ solution; đồng thời các hệ thống cloud đều cung cấp chỉ số về CPU, disk, network và nhiều thành phần khác để giúp xác định bottleneck.

Doanh nghiệp nên theo dõi tối thiểu:

- CPU trung bình và peak

- RAM sử dụng và swap

- disk latency, IOPS, iowait

- throughput mạng

- uptime dịch vụ

- thời gian phản hồi ứng dụng

- số lỗi 4xx, 5xx

- mức tăng trưởng dung lượng log và storage

Khi có cảnh báo sớm, bạn xử lý được trước khi người dùng cảm nhận rõ việc hệ thống chậm đi.

Kết luận

Giải pháp tăng hiệu suất của máy chủ không nằm ở một “mẹo” duy nhất, mà là sự kết hợp giữa đo lường đúng bottleneck, tối ưu phần cứng phù hợp và tinh chỉnh phần mềm theo workload thực tế. Trong rất nhiều trường hợp, hiệu quả cao nhất đến từ 4 nhóm hành động: tăng RAM hợp lý, chuyển sang SSD/NVMe, triển khai cache và cân bằng tải, đồng thời theo dõi hệ thống liên tục để xử lý sớm các điểm nghẽn. Các tài liệu chính thống từ Red Hat, Microsoft, AWS, NGINX và Google Cloud đều đi theo cùng một hướng: tối ưu phải dựa trên dữ liệu thực tế, không phải cảm tính.

FAQ

Làm sao để tăng hiệu suất máy chủ?

Cách hiệu quả nhất là xác định đúng bottleneck rồi tối ưu theo lớp: CPU, RAM, storage, mạng, web server, cache và monitoring.

Nâng RAM có giúp server nhanh hơn không?

Có, đặc biệt khi working set chưa nằm đủ trong bộ nhớ và hệ thống phải đọc đĩa quá nhiều.

SSD có giúp tăng tốc server không?

Có. SSD và NVMe giúp giảm độ trễ đọc ghi, cải thiện I/O và tăng tốc đáng kể cho database, website động và ứng dụng doanh nghiệp.

Cache có làm giảm tải máy chủ không?

Có. NGINX cho biết caching giúp tăng tốc phân phối nội dung và giảm tải cho web/app server phía sau.

Khi nào nên dùng load balancing?

Khi một server đơn lẻ bắt đầu chịu tải cao, cần mở rộng ngang và muốn phân phối request tới nhiều instance để tối ưu hiệu năng và tính sẵn sàng.

Chia sẻ bài viết

Bình luận

( 0 bình luận )Bình luận của bạn

Tin tức liên quan